triplet loss

接下來的Loss function為triplet loss

是為2015使用FaceNet的模型架構的損失函數,是使用三元組的方式,希望經由學習後Anchor和Positive要越近越好,Anchor和Negative則要越遠越好。

a為anchor(已知者,需要辨識的人)

p為positive,與a為同一人但不同張影像(有可能為角度、光線不同的影像)

n為negative,與a為不相同的人

達到同一種類的距離更加緊湊,但不同種類的距離要拉遠。

缺點為如果不同種類的距離本身就很遠,會造成訓練時收斂的時間較長,訓練過程不穩定的因素。

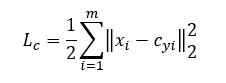

center loss

在來是2016年所提出的center loss,是計算特徵與特徵中心的距離,讓是同一種類的距離更小,訓練時要使用兩個Loss function= Softmax Loss+center loss,希望得到同一種類的變化小於不同種類的距離,就是保持同一種類內緊湊。在訓練模型時在每個類別學習分類、收斂自己類別的中心。

缺點為若有離群點會訓練時對整體模型結果產生較大的影響,導致不易回歸(因為計算的方式為所有點對中心點進行近算後取均值)